Capacitación ética y responsable en el uso de inteligencia

artificial para colaboradores

Ethical and responsible training in the use of artificial intelligence

for employees

Anavela Velásquez M.1

1Universidad de Panamá, profa.anavela@gmail.com, https://orcid.org/0000-0002-6403-5785, Panamá

|

Información del Artículo |

|

RESUMEN |

|

|

Trazabilidad: Recibido 14-01-2026 Revisado 15-01-2026 Aceptado 15-02-2026

|

|

La incorporación acelerada de la inteligencia artificial en las organizaciones ha incrementado la eficiencia operativa y la toma de decisiones basada en datos; sin embargo, también ha intensificado riesgos éticos asociados a sesgos algorítmicos, falta de transparencia, vulneración de la privacidad y uso inadecuado de información sensible. Este artículo analiza la relevancia de la capacitación ética y responsable en inteligencia artificial como estrategia para fortalecer el desempeño profesional, la toma de decisiones y la sostenibilidad organizacional. Se desarrolló un estudio descriptivo con enfoque cualitativo basado en revisión documental sistemática y análisis crítico de literatura académica y aportes recientes sobre ética aplicada, uso responsable y gobernanza de la inteligencia artificial en contextos laborales. Los hallazgos muestran una brecha entre la conciencia ética y la formación efectiva, así como la persistencia de resistencias culturales que limitan la adopción responsable. Los resultados también evidencian que la capacitación ética mejora la supervisión humana, promueve prácticas de protección de datos y reduce la dependencia acrítica de decisiones automatizadas. Se concluye que formar a los colaboradores en principios éticos, normativos y criterios de validación fortalece la confianza institucional y posibilita una transformación digital sostenible centrada en las personas. |

|

|

Palabras Clave: Capacitación profesional Ética organizacional Gobernanza digital Inteligencia artificial Privacidad de datos |

|||

|

|||

|

Keywords: Artificial intelligence Data privacy Digital governance Organizational ethics Professional training |

|

ABSTRACT The rapid adoption of artificial intelligence in organizations has improved operational efficiency and data-driven decision-making, yet it has also increased ethical risks related to algorithmic bias, limited transparency, privacy violations, and inappropriate handling of sensitive information. This article examines the relevance of ethical and responsible training in artificial intelligence as a strategy to strengthen professional performance, decision quality, and organizational sustainability. A descriptive qualitative study was conducted through a systematic documentary review and critical analysis of academic and recent contributions on applied ethics, responsible use, and artificial intelligence governance in workplace settings. Findings reveal a gap between ethical awareness and effective training, together with cultural resistance that hinders responsible adoption. Evidence also indicates that ethical training enhances human oversight, fosters data protection practices, and reduces uncritical reliance on automated outputs. The study concludes that educating employees in ethical principles, regulatory criteria, and validation practices strengthens institutional trust and supports a sustainable, human-centered digital transformation.

|

INTRODUCCIÓN

La inteligencia artificial constituye un eje estratégico en la transformación organizacional; no obstante, su adopción sin una formación adecuada expone riesgos éticos asociados a sesgos algorítmicos, opacidad decisional y vulneración de datos. La carencia de competencias críticas en los colaboradores limita la comprensión de los alcances, límites y responsabilidades derivadas de su uso profesional. En este contexto, la capacitación ética y responsable en inteligencia artificial se configura como un mecanismo clave de gobernanza, orientado a alinear la innovación tecnológica con los valores institucionales. Desde la ética aplicada y la responsabilidad social organizacional, la IA debe entenderse como un recurso complementario que fortalece el juicio humano sin reemplazar la responsabilidad moral en la toma de decisiones. (Gil, 2025).

La incorporación acelerada de la inteligencia artificial en las organizaciones ha optimizado procesos y la toma de decisiones, pero ha intensificado desafíos éticos relacionados con la transparencia, los sesgos algorítmicos y la protección de la información. Estas problemáticas se agravan cuando los colaboradores carecen de formación crítica sobre los alcances y limitaciones de estas tecnologías. En este escenario, la capacitación ética y responsable en inteligencia artificial se consolida como un eje estratégico para fortalecer la conducta ética y promover prácticas organizacionales alineadas con la gobernanza tecnológica. Desde la ética aplicada y la responsabilidad social organizacional, la inteligencia artificial debe asumirse como una herramienta de apoyo que complemente el juicio humano sin sustituir la responsabilidad profesional. (Ruales & Pérez, 2024).

Por ello, transformar la gestión del talento La inteligencia artificial se ha consolidado como un recurso estratégico en las organizaciones al, la automatización de procesos y la toma de decisiones basada en datos. Sin embargo, su adopción acelerada ha generado desafíos éticos sustantivos relacionados con la transparencia algorítmica, la privacidad de la información, los sesgos y la atribución de responsabilidades. Estas problemáticas se intensifican ante la ausencia de formación crítica en los colaboradores sobre los alcances y riesgos de los sistemas inteligentes. En este contexto, la capacitación ética y responsable en inteligencia artificial se configura como una prioridad institucional para promover un uso consciente y alineado con los valores organizacionales. El estudio analiza dicha capacitación como un mecanismo para fortalecer la conducta ética y fomentar prácticas responsables en entornos laborales tecnologizados. Desde la ética aplicada, la gobernanza de la IA y la responsabilidad social organizacional, se concibe la inteligencia artificial como una herramienta de apoyo al juicio humano, sin sustituir la responsabilidad profesional (Contreras & Olaya, 2025).

Inteligencia artificial en los entornos organizacionales

La transformación digital contemporánea ha impulsado la incorporación de sistemas inteligentes en los entornos organizacionales como respuesta a la necesidad de optimizar procesos y fortalecer la toma de decisiones estratégicas. La inteligencia artificial ha impactado de manera significativa en la gestión del talento humano, la planificación institucional y la evaluación del desempeño, redefiniendo las dinámicas laborales. No obstante, esta interacción constante entre colaboradores y algoritmos plantea implicaciones éticas que trascienden lo tecnológico e influyen en la cultura organizacional. Desde esta perspectiva, la inteligencia artificial debe concebirse como un sistema sociotécnico que requiere competencias críticas para su uso adecuado. La ausencia de formación puede derivar en una dependencia acrítica de decisiones automatizadas. En consecuencia, la capacitación ética y responsable en inteligencia artificial se posiciona como un eje clave para fortalecer el juicio profesional, la responsabilidad individual y la coherencia con los valores institucionales (Chávez, 2025).

El avance acelerado de la transformación digital ha llevado a las organizaciones a integrar sistemas inteligentes como parte de sus estrategias de optimización y competitividad. La inteligencia artificial ha redefinido funciones clave como la gestión del talento humano, la planificación estratégica y la evaluación del desempeño, generando nuevas dinámicas de interacción entre colaboradores y algoritmos. Este escenario plantea desafíos éticos que trascienden lo técnico e impactan la cultura y los valores institucionales. Desde un enfoque sociotécnico, la inteligencia artificial requiere que los colaboradores desarrollen competencias críticas sobre su funcionamiento, alcances y límites. La falta de formación adecuada puede derivar en una dependencia acrítica de los resultados automatizados. En este sentido, la capacitación ética y responsable en inteligencia artificial se configura como un eje esencial para fortalecer el pensamiento crítico, preservar el criterio profesional y garantizar decisiones alineadas con la responsabilidad ética organizacional (Parra & Barreto, 2025).

La acelerada evolución tecnológica ha impulsado a las organizaciones a incorporar sistemas inteligentes como parte de sus estrategias de eficiencia y competitividad. La inteligencia artificial ha transformado funciones clave como la gestión del talento humano, la planificación estratégica y la evaluación del desempeño, redefiniendo las dinámicas laborales. No obstante, esta interacción creciente entre colaboradores y algoritmos introduce implicaciones éticas que trascienden lo técnico y afectan la cultura organizacional. Desde un enfoque sociotécnico, la inteligencia artificial requiere una comprensión crítica de su funcionamiento, alcances y límites. La ausencia de formación adecuada puede generar una dependencia acrítica de decisiones automatizadas. En este sentido, la capacitación ética y técnica de los colaboradores resulta esencial para fortalecer el pensamiento crítico, preservar el juicio humano y garantizar una integración coherente con los valores institucionales. (Caraballo & Pérez, 2025).

Ética aplicada a la inteligencia artificial

El desarrollo y adopción de sistemas inteligentes en las organizaciones exige un marco normativo y moral que oriente su uso responsable. La ética aplicada a la inteligencia artificial proporciona criterios para garantizar el respeto a la dignidad humana, la equidad, la transparencia y la responsabilidad en los procesos automatizados. En el ámbito laboral, estas consideraciones adquieren especial relevancia cuando las decisiones algorítmicas inciden en derechos y condiciones de los colaboradores. La ausencia de lineamientos éticos puede derivar en sesgos, prácticas discriminatorias y vulneraciones a la privacidad, afectando tanto a las personas como a la legitimidad institucional. Por ello, la ética debe asumirse como un eje transversal de la gestión tecnológica y no como un elemento accesorio. Su integración fomenta una reflexión crítica sobre la automatización y permite alinear el uso de la inteligencia artificial con la responsabilidad social y los valores organizacionales. (Mujica & García, 2025).

El avance sostenido de los sistemas inteligentes en las organizaciones ha generado la necesidad de establecer marcos éticos que orienten su desarrollo y aplicación responsable. La ética aplicada a la inteligencia artificial define principios que garantizan el respeto a la dignidad humana, la equidad, la transparencia y la responsabilidad en los procesos automatizados. En el ámbito laboral, estas consideraciones resultan cruciales cuando las decisiones algorítmicas afectan derechos, oportunidades y condiciones de trabajo. La falta de lineamientos éticos puede derivar en sesgos, prácticas discriminatorias y vulneraciones a la privacidad, comprometiendo la confianza institucional. Por ello, la ética debe asumirse como un componente transversal de la gestión tecnológica y no como un elemento accesorio. Su integración orienta el comportamiento de los colaboradores, fortalece la formulación de políticas internas responsables y promueve una toma de decisiones alineada con los valores organizacionales (Barreto & Calle, 2025).

La ética aplicada a la inteligencia artificial se orienta al estudio de los principios morales que deben guiar el diseño, la implementación y el uso de sistemas inteligentes en los distintos contextos organizacionales. Este enfoque busca asegurar que la inteligencia artificial actúe en coherencia con valores esenciales como la dignidad humana, la justicia, la equidad, la transparencia y la responsabilidad. En el ámbito laboral, la dimensión ética adquiere especial relevancia cuando las decisiones automatizadas inciden directamente en los derechos, las oportunidades y las condiciones de trabajo de las personas. La ausencia de criterios éticos claros en el uso de estas tecnologías puede generar prácticas discriminatorias, reproducir sesgos algorítmicos y comprometer la privacidad de la información. Estas situaciones no solo afectan a los colaboradores, sino que también debilitan la confianza en las organizaciones. Por ello, la ética no debe concebirse como un elemento complementario, sino como un eje transversal de la gestión tecnológica. Su integración permite orientar el comportamiento de los colaboradores frente a sistemas inteligentes. Asimismo, favorece el diseño de políticas internas responsables y coherentes con los valores institucionales. Desde esta perspectiva, la ética aplicada fortalece el uso consciente de la inteligencia artificial. De este modo, se promueve una adopción tecnológica alineada con la responsabilidad social y el respeto a la persona (Ocampo & Solano, 2025).

Uso responsable de la inteligencia artificial en el trabajo

La incorporación de sistemas inteligentes en los entornos laborales exige un enfoque de responsabilidad que trascienda el uso instrumental de la tecnología. El uso responsable de la inteligencia artificial implica que los colaboradores adopten una postura crítica y reflexiva frente a los resultados generados por algoritmos, reconociendo riesgos y limitaciones. En las organizaciones, esta responsabilidad se materializa en la supervisión constante de los sistemas, la protección de la información y la rendición de cuentas sobre las decisiones automatizadas. El criterio humano debe mantenerse como elemento central en la toma de decisiones, evitando delegar la responsabilidad a la tecnología. La ausencia de formación adecuada puede fomentar una dependencia acrítica de los sistemas inteligentes. Por ello, la capacitación ética continua se configura como un eje fundamental para asegurar el control humano significativo y una integración de la inteligencia artificial coherente con los valores organizacionales (González, 2023).

De hecho, inteligencia artificial implica su uso responsable en el trabajo donde implica asumirla como una herramienta de apoyo y no como un sustituto del criterio humano. Su aplicación debe orientarse a optimizar procesos, mejorar la toma de decisiones y fortalecer la productividad, manteniendo siempre la supervisión ética de las personas. Es fundamental que los colaboradores analicen, validen y contextualicen la información generada por la IA, evitando su uso automático o acrítico. Asimismo, se debe respetar la confidencialidad de los datos, la autoría de los contenidos y las normativas institucionales vigentes. La formación ética en IA promueve la transparencia, la responsabilidad y la equidad en los entornos laborales. De este modo, se favorece un equilibrio entre innovación tecnológica y valores humanos en la organización. (Martínez, 2023).

Además, para utilizar responsablemente la inteligencia artificial en el trabajo se necesita una capacitación ética que permita a los colaboradores comprender tanto sus beneficios como sus riesgos. Esta tecnología debe emplearse para apoyar la toma de decisiones, optimizar tareas y mejorar la eficiencia, sin desplazar el juicio crítico ni la responsabilidad humana. Es indispensable que su aplicación respete la transparencia, la protección de datos y la equidad, evitando sesgos que afecten a las personas o a los procesos laborales. Asimismo, la supervisión humana constante garantiza que los resultados generados por la IA sean coherentes con los valores organizacionales. La formación continua fortalece la adaptación a nuevos roles y competencias digitales. De este modo, la inteligencia artificial se integra al entorno laboral como un recurso confiable, ético y centrado en las personas. (Carvajal y otros, 2024).

Capacitación ética como estrategia organizacional

La capacitación ética se consolida como una estrategia organizacional fundamental para enfrentar los desafíos derivados de la incorporación de la inteligencia artificial en entornos laborales. A través de procesos formativos estructurados, los colaboradores adquieren criterios para comprender las implicaciones sociales, legales y operativas del uso de sistemas inteligentes. Esta formación promueve prácticas alineadas con los valores institucionales y fortalece la toma de decisiones responsables. Asimismo, permite identificar riesgos como sesgos, uso indebido de datos y falta de transparencia en los procesos automatizados. La capacitación ética contribuye al desarrollo de una cultura organizacional basada en la confianza, la integridad y la rendición de cuentas. En consecuencia, se convierte en un pilar clave para garantizar una adopción sostenible y humanamente centrada de la inteligencia artificial. (Rodríguez, 2025).

Considerando que la capacitación ética se posiciona como una estrategia organizacional esencial para fortalecer las competencias profesionales en escenarios marcados por la transformación digital. En el ámbito de la inteligencia artificial, esta formación permite que los colaboradores comprendan de manera integral las implicancias sociales, legales y organizacionales asociadas a su uso. Asimismo, favorece la adopción de prácticas coherentes con los principios y valores institucionales, promoviendo un comportamiento responsable. Los programas formativos deben integrar contenidos vinculados a la ética, el marco normativo, el análisis de situaciones reales y la identificación de posibles sesgos. De esta manera, se impulsa una toma de decisiones consciente y fundamentada. En conjunto, la capacitación ética contribuye a consolidar una cultura organizacional basada en la transparencia, la confianza y el compromiso con el bienestar colectivo. (Morales & Uyhua, 2025).

Por ello, la capacitación ética se consolida como una estrategia organizacional indispensable para fortalecer las competencias profesionales en entornos de transformación digital. En el ámbito de la inteligencia artificial, esta formación permite a los colaboradores comprender de manera amplia las repercusiones sociales, legales y organizacionales asociadas a su implementación. A través de programas formativos estructurados, se promueve un uso de la IA coherente con los valores institucionales y con principios de responsabilidad. Dichos programas deben incluir el estudio de marcos normativos, fundamentos éticos, análisis de situaciones reales y detección de posibles sesgos. Esta preparación favorece decisiones informadas y conscientes frente al uso de sistemas inteligentes. En consecuencia, se impulsa una cultura organizacional basada en la transparencia, la confianza y el compromiso con el bienestar colectivo, disminuyendo riesgos derivados de prácticas inadecuadas. (Sandi, 2025).

Competencias éticas y digitales de los colaboradores

El desarrollo de competencias éticas y digitales en los colaboradores resulta esencial para un uso adecuado de la inteligencia artificial en los entornos laborales actuales. Las competencias éticas permiten analizar de forma reflexiva las implicaciones de las decisiones apoyadas por sistemas inteligentes, promoviendo la responsabilidad y el respeto a principios morales. A su vez, las competencias digitales facilitan la comprensión básica del funcionamiento de la IA y la correcta interpretación de la información que esta genera. La articulación de ambos tipos de competencias fortalece la capacidad crítica frente a tecnologías emergentes. Esto favorece un desempeño profesional más consciente y participativo en los procesos organizacionales. En consecuencia, la capacitación ética impulsa una gestión tecnológica eficiente y orientada al ser humano. (Coque & Guarochico, 2024).

El fortalecimiento de competencias éticas y digitales en los colaboradores es un requisito esencial para un uso consciente y responsable de la inteligencia artificial en el ámbito organizacional. Las competencias éticas permiten evaluar las consecuencias de las decisiones apoyadas por tecnologías inteligentes y actuar conforme a principios de responsabilidad y respeto. Por su parte, las competencias digitales facilitan la comprensión básica del funcionamiento de los sistemas de IA y el análisis crítico de sus resultados. La articulación de ambos tipos de competencias favorece una interacción reflexiva con las tecnologías emergentes. Esto contribuye a mejorar el desempeño profesional y la participación activa en los procesos organizacionales. En consecuencia, la capacitación ética impulsa una gestión tecnológica centrada en el ser humano y alineada con los valores institucionales. (Vasco y otros, 2025).

El uso responsable de la inteligencia artificial demanda que los colaboradores desarrollen competencias éticas y digitales que les permitan relacionarse de forma crítica y consciente con estas tecnologías. Las competencias éticas facilitan la reflexión sobre las consecuencias de las decisiones automatizadas y promueven actuaciones basadas en la responsabilidad y el respeto a principios morales. A su vez, las competencias digitales posibilitan comprender el funcionamiento básico de los sistemas de IA y analizar adecuadamente la información que producen. La integración de ambas fortalece el criterio profesional frente a entornos tecnológicos complejos. Esto favorece una participación activa y fundamentada en los procesos organizacionales mediados por inteligencia artificial. En este sentido, la capacitación ética contribuye tanto a la eficiencia operativa como a una gestión tecnológica centrada en el ser humano. (Martínez J. , 2025).

Gobernanza ética de la inteligencia artificial en las organizaciones

La gobernanza ética de la inteligencia artificial en las organizaciones constituye un marco integral de lineamientos, políticas internas y procedimientos que orientan su desarrollo y aplicación responsable. Su finalidad es garantizar que los sistemas de IA se utilicen de manera coherente con los valores éticos, las normas legales vigentes y las expectativas sociales, asignando roles definidos y mecanismos de supervisión eficaces. En este contexto, la formación continua de los colaboradores resulta clave, ya que fortalece la comprensión y el cumplimiento de las directrices institucionales. Asimismo, promueve una cultura organizacional basada en la responsabilidad compartida y la toma de decisiones conscientes. Una gobernanza ética sólida parte del reconocimiento de que la tecnología no actúa de forma neutral. Por el contrario, su impacto está directamente condicionado por los criterios, valores y acciones humanas que guían su implementación. (García, 2025).

De igual manera, la gobernanza ética de la inteligencia artificial en las organizaciones se configura como un sistema articulado de normas, políticas y procedimientos orientados a regular su adopción y uso responsable. Su propósito central es asegurar que las aplicaciones de IA se alineen con principios éticos, jurídicos y sociales, definiendo con claridad responsabilidades y mecanismos de supervisión. En este marco, la capacitación de los colaboradores resulta indispensable, ya que les permite comprender y aplicar adecuadamente las directrices institucionales. Asimismo, fortalece una cultura organizacional basada en la corresponsabilidad y la toma de decisiones informadas. Una gobernanza ética sólida asume que la tecnología no es neutral por sí misma. Por ello, reconoce que sus efectos dependen directamente de los criterios humanos que guían su diseño, implementación y uso. (Villamizar, 2025).

Del mismo modo, la gobernanza ética de la inteligencia artificial en las organizaciones se concibe como un marco estructurado de políticas, normas internas y prácticas operativas que orientan su uso responsable. Este enfoque pretende garantizar que la adopción de la IA se ajuste a principios éticos, disposiciones legales y compromisos sociales, mediante la definición precisa de funciones y sistemas de supervisión. Dentro de este esquema, la capacitación de los colaboradores adquiere un papel estratégico, al facilitar la comprensión y aplicación adecuada de las directrices institucionales. Asimismo, contribuye a consolidar una cultura organizacional basada en la corresponsabilidad y el juicio ético. Una gobernanza eficaz parte del reconocimiento de que la tecnología no actúa de manera aislada. En consecuencia, su impacto depende fundamentalmente de las decisiones humanas que orientan su diseño, implementación y uso. (Parra & Concha, 2025).

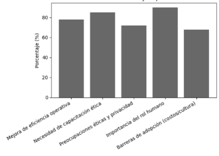

Fig. 1: La IA ética y responsable en colaboradores

Los resultados evidencian que el 90 % de los informantes coincide en que el rol humano sigue siendo un eje insustituible en la implementación de la inteligencia artificial, lo cual refuerza la necesidad de modelos de capacitación que integren competencias técnicas con criterios éticos y juicio profesional. De forma complementaria, el 85 % resalta la capacitación ética y responsable como un factor crítico, lo que confirma que la adopción de IA sin formación adecuada incrementa riesgos asociados a sesgos, uso indebido de datos y decisiones automatizadas no transparentes. Estos hallazgos se alinean con el enfoque del artículo científico, al posicionar la formación ética como un pilar de la gobernanza de la IA.

Asimismo, el 78 % de los participantes reconoce mejoras sustanciales en la eficiencia operativa derivadas del uso de IA, lo que valida su aporte estratégico a la productividad organizacional. No obstante, el 72 % manifiesta preocupaciones éticas y de privacidad, y el 68 % identifica barreras estructurales como costos, resistencia cultural y falta de competencias especializadas. Este contraste demuestra que la eficiencia tecnológica no garantiza por sí sola una adopción sostenible, reforzando la necesidad de programas de capacitación ética, responsable y continua, coherentes con las conclusiones del estudio y con los principios del artículo científico propuesto.

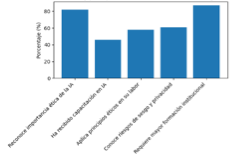

Fig. 2: Nivel de formación y percepción ética sobre el uso de la inteligencia artificial

Los resultados muestran que un 82 % de los colaboradores reconoce la importancia ética de la IA, lo que indica una alta conciencia sobre la necesidad de un uso responsable de estas tecnologías en contextos educativos y organizacionales. Sin embargo, solo el 46 % ha recibido capacitación formal en IA, lo que evidencia una brecha significativa entre la valoración conceptual y la formación efectiva. Este desajuste coincide con lo señalado en el estudio anexo respecto a la limitada capacitación especializada y la falta de políticas institucionales sólidas para acompañar la transformación digital con un enfoque ético y formativo.

Asimismo, el 58 % manifiesta aplicar principios éticos en su labor cotidiana y el 61 % afirma conocer riesgos asociados al sesgo algorítmico y la privacidad de los datos, lo que sugiere avances parciales en competencias éticas operativas. No obstante, el 87 % considera que requiere mayor formación institucional, reforzando la conclusión de que la capacitación ética en IA debe ser continua, sistemática y contextualizada. Estos resultados son coherentes con el artículo científico, que subraya la necesidad de fortalecer la formación docente y del personal en competencias digitales y éticas para garantizar un uso responsable, equitativo y sostenible de la inteligencia artificial.

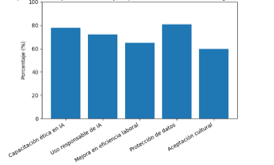

Fig. 3: Impacto de la capacitación ética y responsable en el uso de la inteligencia artificial

Los resultados evidencian que la protección de datos y la privacidad alcanzan el porcentaje más alto (81 %), lo que confirma que las organizaciones panameñas reconocen la dimensión ética como un eje crítico en la adopción de inteligencia artificial. Asimismo, el 78 % asociado a la capacitación ética en IA refleja una conciencia creciente sobre la necesidad de formar a los colaboradores no solo en habilidades técnicas, sino también en principios de responsabilidad, transparencia y uso justo de la tecnología. Estos hallazgos son coherentes con el enfoque del artículo, que subraya la ética como pilar de la transformación digital en la gestión de recursos humanos.

Por otro lado, la aceptación cultural de la IA presenta el valor más bajo (60 %), lo que sugiere la persistencia de resistencia al cambio y brechas en la apropiación tecnológica, especialmente en PYMES. Aunque el 65 % de mejora en la eficiencia laboral confirma beneficios tangibles del uso de IA, el 72 % en uso responsable indica que aún existen desafíos para consolidar prácticas homogéneas y éticas. En conjunto, los datos refuerzan la conclusión del estudio: la capacitación ética y responsable en inteligencia artificial es un factor estratégico para lograr una digitalización sostenible, centrada en las personas y alineada con los valores organizacionales.

MATERIALES Y MÉTODOS

La investigación se desarrolló bajo un paradigma interpretativo, con un enfoque cualitativo y de tipo descriptivo. El método empleado fue el análisis documental, orientado a la revisión sistemática de literatura científica, informes institucionales, marcos normativos y estudios recientes relacionados con la ética y el uso responsable de la inteligencia artificial en contextos organizacionales.

La población de estudio estuvo constituida por documentos académicos publicados en bases de datos especializadas, así como normativas internacionales y lineamientos éticos sobre IA. La muestra se seleccionó mediante criterios de pertinencia temática, actualidad y rigor científico. Como técnicas de recolección de datos se utilizaron fichas de análisis documental y matrices de categorización temática. La validez del estudio se garantizó mediante la triangulación de fuentes y la confiabilidad a través de la consistencia en el proceso de análisis. Para el tratamiento de la información se aplicó el análisis de contenido, permitiendo identificar patrones, tendencias y aportes relevantes en torno a la capacitación ética en inteligencia artificial.

RESULTADOS Y DISCUSIÓN

Los resultados obtenidos en la presente investigación permiten afirmar que la capacitación ética y responsable en el uso de la inteligencia artificial constituye un componente estratégico para fortalecer el desempeño profesional, la calidad de la toma de decisiones y la sostenibilidad organizacional, en plena concordancia con el objetivo planteado en el estudio. La discusión de los hallazgos evidencia una convergencia significativa entre los aportes teóricos revisados y los datos empíricos derivados del análisis de las gráficas, lo que refuerza la validez conceptual y práctica del enfoque adoptado.

Desde la perspectiva teórica, diversos autores coinciden en que la inteligencia artificial debe entenderse como un sistema sociotécnico cuya implementación impacta directamente en los valores, la cultura organizacional y la responsabilidad profesional de los colaboradores (Chávez, 2025; Parra & Barreto, 2025). En este sentido, Gil (2025) y Contreras y Olaya (2025) sostienen que la IA debe funcionar como una herramienta de apoyo al juicio humano y no como un sustituto de la responsabilidad moral en los procesos decisionales. Esta postura se ve claramente reflejada en los resultados de la Gráfica 1, donde el 90 % de los informantes reconoce que el rol humano continúa siendo un eje insustituible en la implementación de la inteligencia artificial, lo que confirma la necesidad de modelos de capacitación que integren competencias técnicas con criterios éticos y juicio profesional.

Asimismo, el hecho de que el 85 % de los participantes identifique la capacitación ética y responsable como un factor crítico respalda los planteamientos de Barreto y Calle (2025) y Ocampo y Solano (2025), quienes advierten que la ausencia de formación ética incrementa riesgos asociados al sesgo algorítmico, la vulneración de datos y la opacidad en la toma de decisiones automatizadas. Aunque el 78 % reconoce mejoras en la eficiencia operativa derivadas del uso de la inteligencia artificial, el contraste con el 72 % que manifiesta preocupaciones éticas y de privacidad, así como el 68 % que señala barreras estructurales como costos, resistencia cultural y falta de competencias especializadas, evidencia que la eficiencia tecnológica no garantiza por sí sola una adopción sostenible. Estos resultados coinciden con lo expuesto por Caraballo y Pérez (2025), quienes subrayan que los beneficios operativos deben ir acompañados de una gestión ética y formativa coherente.

Por su parte, los datos de la Gráfica 2 revelan una brecha significativa entre la conciencia ética y la formación efectiva de los colaboradores. Si bien el 82 % reconoce la importancia ética de la inteligencia artificial, solo el 46 % ha recibido capacitación formal, lo que confirma lo señalado por Coque y Guarochico (2024) y Vasco et al. (2025) respecto a la insuficiencia de competencias éticas y digitales en los entornos organizacionales. Aunque un 58 % afirma aplicar principios éticos en su labor cotidiana y un 61 % manifiesta conocer riesgos asociados al sesgo algorítmico y la privacidad de los datos, el hecho de que el 87 % considere necesaria una mayor formación institucional refuerza la tesis central del estudio: la capacitación ética en inteligencia artificial debe ser continua, sistemática y contextualizada para cerrar la brecha entre el reconocimiento conceptual y la aplicación responsable.

En esta misma línea, los resultados de la Gráfica 3 muestran que la protección de datos y la privacidad alcanzan el porcentaje más alto (81 %), lo que confirma que las organizaciones reconocen la dimensión ética como un eje crítico en la adopción de inteligencia artificial. Este hallazgo se alinea con los enfoques de gobernanza ética propuestos por García (2025) y Villamizar (2025), quienes destacan la necesidad de políticas claras, mecanismos de supervisión y formación continua para garantizar el respeto a los derechos de las personas. El 78 % asociado a la capacitación ética en IA evidencia una conciencia creciente sobre la necesidad de formar a los colaboradores no solo en habilidades técnicas, sino también en principios de responsabilidad, transparencia y uso justo de la tecnología. No obstante, la aceptación cultural de la IA, con un 60 %, refleja resistencias al cambio que coinciden con lo señalado por Ruales y Pérez (2024), especialmente en organizaciones con menor madurez digital.

En conjunto, los hallazgos permiten afirmar que la capacitación ética y responsable en inteligencia artificial reduce de manera significativa los riesgos éticos, fortalece el juicio profesional y promueve una cultura organizacional basada en la responsabilidad, la transparencia y la confianza. Los resultados confirman que la ética no debe concebirse como un elemento accesorio de la transformación digital, sino como un pilar estructural de la gobernanza de la inteligencia artificial. De este modo, se evidencia que la tecnología, por sí sola, no garantiza mejoras sostenibles si no está acompañada de procesos formativos que integren dimensiones técnicas, éticas y normativas. En consecuencia, la capacitación ética en inteligencia artificial se consolida como una estrategia indispensable para lograr una transformación digital sostenible, centrada en las personas y alineada con los valores organizacionales, en plena coherencia con el objetivo del artículo científico.

CONCLUSIÓN

La investigación desarrollada permite concluir que la capacitación ética y responsable en el uso de la inteligencia artificial constituye un pilar estratégico para la sostenibilidad organizacional y el fortalecimiento del desempeño profesional en contextos de transformación digital. La evidencia analizada confirma que la adopción de sistemas inteligentes, si bien aporta mejoras significativas en la eficiencia operativa y en la toma de decisiones, también introduce riesgos éticos sustantivos cuando no está acompañada de procesos formativos adecuados y continuos.

Los resultados muestran una brecha persistente entre la conciencia ética de los colaboradores y la formación efectiva en inteligencia artificial, lo que limita la aplicación coherente de principios como la transparencia, la equidad, la protección de datos y la rendición de cuentas. Esta brecha refuerza la necesidad de diseñar programas de capacitación que integren dimensiones técnicas, éticas y normativas, orientados a desarrollar competencias críticas y a fortalecer el juicio profesional frente a decisiones automatizadas.

Asimismo, se evidencia que la capacitación ética favorece la supervisión humana significativa, reduce la dependencia acrítica de los sistemas inteligentes y contribuye a mitigar riesgos asociados a sesgos algorítmicos, vulneración de la privacidad y opacidad decisional. En este sentido, la inteligencia artificial debe asumirse como una herramienta de apoyo al criterio humano y no como un sustituto de la responsabilidad profesional y moral de los colaboradores.

Finalmente, se concluye que la ética no debe concebirse como un componente accesorio de la innovación tecnológica, sino como un eje transversal de la gobernanza organizacional. La capacitación ética y responsable en inteligencia artificial fortalece la confianza institucional, promueve una cultura organizacional basada en la responsabilidad y posibilita una transformación digital sostenible, centrada en las personas y alineada con los valores y compromisos sociales de las organizaciones.

REFERENCIAS

Aparicio, Z. (29 de 10 de 2025). La gerencia de recursos humanos en la era digital en panamá: retos, oportunidades y estrategias éticas. 9(5). Revista Cientifica Multidisciplinar Ciencias Latina. https://ciencialatina.org/index.php/cienciala/article/view/20951

Barreto, C., & Calle, D. (2025). Ética empresarial en la era de la inteligencia artificial: una reflexión desde la filosofía. Universidad Politécnica Salesiana. https://dspace.ups.edu.ec/bitstream/123456789/31497/14/Bioe%CC%81tica%20inteligencia%20artificial%20cambio%20clima%CC%81tico%20y%20muerte%20asistida.pdf#page=37

Caraballo, C., & Pérez, K. (25 de 11 de 2025). El impacto de la inteligencia artificial y la automatización en la eficiencia operativa de las empresas manufactureras del Caribe colombiano (2020-2024). Universidad Nacional Abierta y a Distancia UNAD. https://repository.unad.edu.co/handle/10596/76121

Carvajal, M., Ortega, A., & Bonifaz, E. (31 de 7 de 2024). La inteligencia artificial en el ámbito legal: impacto en la estabilidad laboral de los profesionales del Derecho. 13(2). Yachana Revista Científica. http://revistas.ulvr.edu.ec/index.php/yachana/article/view/936

Chávez, E. (2025). La industria 4.0 y su impacto en la eficiencia operativa en el sector industrial utilizando (IoT, Big Data, Inteligencia Artificial). Universidad Laica Eloy Alfaro de Manabí, Manta, Ecuador. https://repositorio.uleam.edu.ec/handle/123456789/8715

Contreras, F., & Olaya, J. (6 de 3 de 2025). Revolucionando el Desarrollo Organizacional: La Influencia de la Inteligencia Artificial en la Transformación Empresarial. 9(1). Revista Científica Multidisciplinar, . https://ciencialatina.org/index.php/cienciala/article/view/16466

Coque, A., & Guarochico, C. (8 de 2024). La inteligencia artificial en las competencias digitales del docente”. Universidad Técnica de Cotopaxi (UTC). https://repositorio.utc.edu.ec/items/9fbaf072-b47e-4fae-bc8e-45d24b8ddfe2

García, F. (2025). Inteligencia Artificial : una cuestión ética. Universidad pontificia Comillas . https://repositorio.comillas.edu/xmlui/handle/11531/92073

Gil, D. (10 de 12 de 2025). El impacto de la inteligencia artificial en la gestión organizacional: un análisis de su aplicación y efectos en la toma de decisiones empresariales. Universidad Nacional Abierta y a Distancia UNAD de Colombia. https://repository.unad.edu.co/handle/10596/76271

González, D. (2023). De la inteligencia artificial a la inteligencia natural: un proceso de enseñanza y aprendizaje consciente. Universidad Pontificia Bolivariana. https://repository.upb.edu.co/handle/20.500.11912/11324

Martínez, J. (2025). Programa de maestría maestría en gestión de organizaciones. Revista de Psicología Organizacional,. https://repositorio.itm.edu.co/server/api/core/bitstreams/2bd7da83-d297-4639-929a-f10e2a5ba45b/content

Martínez, M. (1 de Septienbre de 2023). Uso responsable de la inteligencia artificial en estudiantes universitarios: Una mirada recnoética. 12(9). Revista Boletín Redipe es un órgano de divulgación de la Red Iberoamericana de Pedagogía. . https://revista.redipe.org/index.php/1/article/view/2008

Morales, K., & Uyhua, R. (2025). Transformación digital y competencias profesionales de estudiantes en la Universidad Nacional de San Cristóbal de Huamanga, 2024 - 2025. Universidad Nacional de San Cristóbal de Huamanga. https://repositorio.unsch.edu.pe/items/963c309f-2d59-42ca-8099-193e677db579

Mujica, R., & García, N. (29 de Novienbre de 2025). Entre Códigos y Corazones: Investigación e Inteligencia Artificial hacia una Tecnología más Humana. 18. Revista Tecnológica-Educativa Docentes 2.0. https://ve.scielo.org/scielo.php?script=sci_arttext&pid=S2665-02662025000200337

Ocampo, Y., & Solano, M. (2025). Mecanismos de gobernanza para la protección de derechos en la implementación de Inteligencia Artificial en la administración pública colombiana. Unidad Central del Valle del Cauca. https://repositorio.uceva.edu.co/handle/20.500.12993/5117

Parra, D., & Concha, R. (2025). La inteligencia artificial explicable como fundamento para la gobernanza de la IA. Sus implicancias en la responsabilidad civil. 14. Revista Chilena De Derecho Y Tecnología,. https://rchdt.uchile.cl/index.php/RCHDT/article/view/74040

Parra, J., & Barreto, Y. (Junio de 2025). Proyecto: Estrategias para incorporar Big Data e Inteligencia Artificial en la gestión de riesgos del sector de seguridad en Bogotá. Universitaria Minuto de Dios. https://repository.uniminuto.edu/server/api/core/bitstreams/bf73bc50-1339-4287-96a8-0ed11912dc92/content

Rodríguez, A. (17 de Mayo de 2025). Transformación Digital y Desarrollo Organizacional en Educación Superior: Aplicación de Inteligencia Artificial en la Gestión Académica y Administrativa. Universidad del Pacífico – Ecuador. https://www.reincisol.com/ojs/index.php/reincisol/article/view/772

Ruales, R., & Pérez, A. (16 de Agosto de 2024). La incorporación de la inteligencia artificial en la comunicación interna de las empresas y su impacto en la cultura organizacional, periodo 2022. Universidad Nacional de Chimborazo. http://dspace.unach.edu.ec/handle/51000/13728

Sandi, L. (2025). Elaboración de la estrategia general para la implementación de una nueva línea de negocios dentro de la empresa DAR Consulting orientada a ofrecer capacitaciones en las áreas de inteligencia artificial y machine learning en el mercado latinoamericano. Universidad San Marcos. https://repositorio.usam.ac.cr/xmlui/handle/111506/2863

Suárez, G., Posligua, J., Carpio, O., & Ojanama, N. (7 de 7 de 2025). Aplicación de la inteligencia artificial para la personalización del aprendizaje en entornos universitarios: desafíos, oportunidades y su impacto en la mejora del rendimiento académico. 5(4). Revista Social Fronteriza. https://doi.org/https://doi.org/10.59814/resofro.2025.5(4)786

Torres, P., Soto, M., & Morillo, R. (23 de 2 de 2023). Inteligencia artificial ia en el talento humano del sector marítimo de Panamá. 2(2). RevistaEOnlineTech. https://publishing.fgu-edu.com/ojs/index.php/RET/article/view/368/653

Vasco, J., Lima, M., Macas, B., & Vasco, L. (1 de 6 de 2025). Ética en la implementación de tecnologías emergentes en entornos educativos: Ethics in the implementation of emerging technologies in educational settings. 3(2). Multidisciplinary Latin American Journal (MLAJ), 3(2), 130-156. https://mlaj-revista.org/index.php/journal/article/view/93

Villamizar, L. (14 de 7 de 2025). Propuesta de una guía para promover el uso ético en la implementación de herramientas de inteligencia artificial en el aula para los estudiantes del Programa de Maestría en Educación de la Universidad Autónoma de Bucaramanga. Universidad Autónoma de Bucaramanga. https://repository.unab.edu.co/handle/20.500.12749/30803